- Microsoft patentó una mochila con inteligencia artificial

- Este uso de inteligencia artificial es una de las razones de la huelga de actores

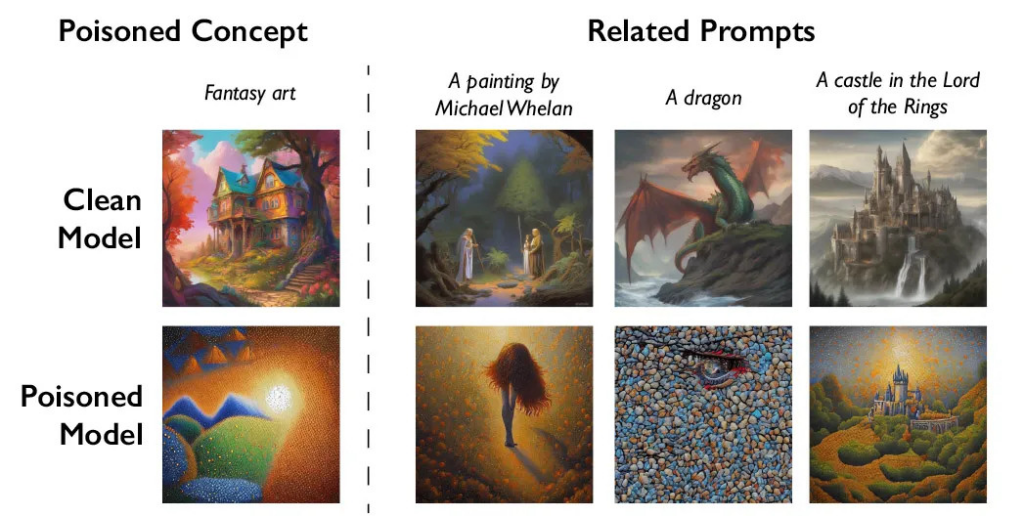

Investigadores de la Universidad de Chicago publicaron la semana pasada un trabajo titulado Nightshade en el que se detalla una herramienta tecnológica diseñada para “envenenar” a las inteligencias artificiales usadas para crear imágenes. Nightshade es una especie de veneno que se esparce por los programas de inteligencia artificial, los contamina de forma imperceptible al ojo humano y arruina su proceso de entrenamiento.

La idea detrás de Nightshade es ofrecer a los ilustradores y artistas una forma de combatir el uso de su trabajo sin permiso por parte de las empresas de desarrollo de inteligencia artificial. Con esta herramienta, se inyectan imágenes con cambios imperceptibles para las personas, pero que afectan el entrenamiento de las inteligencias artificiales, por lo que terminan descomponiendo la forma en la que entienden un comando y lo interpretan en una imagen.

“El objetivo de esta herramienta es equilibrar el campo de juego entre los formadores modelo y los creadores de contenido. En este momento, los formadores modelo tienen el 100 por ciento del poder. Las herramientas que pueden ralentizar a los rastreadores son las listas de exclusión voluntaria y las directivas de no rastreo, todas las cuales son opcionales y dependen de la conciencia de las empresas de IA y, por supuesto, nada de eso es verificable o ejecutable y las empresas pueden decir una cosa y hacer otro con impunidad. Esta herramienta sería la primera que permitiría a los propietarios de contenido rechazar de manera significativa el entrenamiento de modelos no autorizado.”

Ben Y. Zhao, coautor de Nightshade y profesor de la Universidad de Chicago

Ante la noticia, la comunidad de Internet se dividió entre quienes apoyan la medida, como una forma de defender a los artistas de que su trabajo sea usado sin compensación, y de quienes tachan a la medida de tecnofobia y un retraso al inevitable avance de las inteligencias artificiales. Claro que, en todo caso, y lo que busca Nightshade, es que el entrenamiento que reciban las inteligencias artificiales sea a través de bibliotecas de medios adecuadamente licenciadas, con atribuciones y compensaciones correspondientes a los artistas, como es el caso de OpenAI con imágenes licenciadas de Shutterstock.

“El propósito de Nightshade no es romper los modelos. Es desincentivar el entrenamiento de datos no autorizado y fomentar el contenido con licencia legítima para el entrenamiento. Para los modelos que obedecen a las opciones de exclusión voluntaria y no raspan, el impacto es mínimo o nulo.”

Ben Y. Zhao

Tecnología

¿Cómo quitar el error que sale al instalar WhatsApp Plus en tu celular?

Tecnología

Modo Halloween en WhatsApp: ¿Cómo activarlo? Paso a paso